Ostatnio, Uruchomiono Amazona jego chatbot AI Amazon Q, wywołujący zainteresowanie firm, ale także obawy wśród pracowników dotyczące poważnych problemów z dokładnością i prywatnością. Zgłoszono, że Q ma „halucynacje nie poco opowieść” i ujawnił poufne dane, budząc pytania o bezpieczeństwo informacji firmy. Oto szczegóły ujawnione przez Platformówka.

Alert bezpieczeństwa dla Amazon Q: pomiędzy poufnymi danymi a błędnymi odpowiedziami

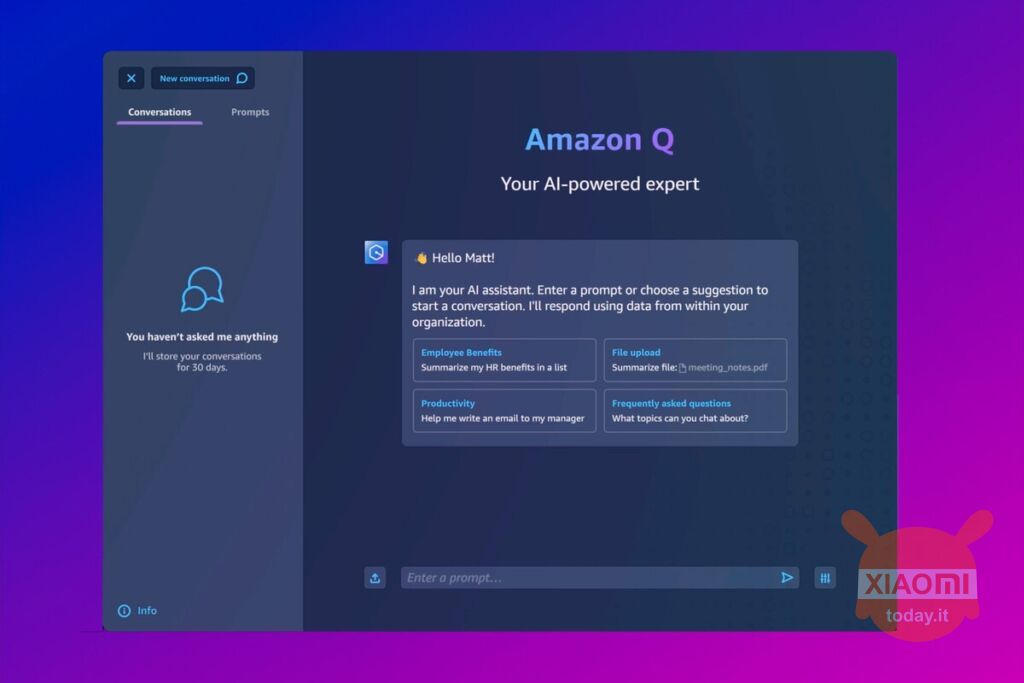

Amazonka wprowadzono swojego chatbota AI o nazwie Q, trzy dni temu, ale nie wydaje się, aby wszystko przebiegało zgodnie z planem. Niektórzy pracownicy podnieśli alarm w związku z kwestiami dokładności i prywatności: Amazon Q miałby „halucynacje” i ujawniłby je informacja poufny, takie jak lokalizacja centrów danych AWS, wewnętrzne programy rabatowe i funkcje, które nie zostały jeszcze udostępnione.

Informacje te wyłoniły się z dokumentów, które wyciekły i uzyskały m.in Platformówka, podkreślając Problem bezpieczeństwa poziomu 2, poważna sytuacja wymagająca pilnej interwencji inżynierów.

Mimo to Amazon bagatelizował znaczenie tych wewnętrznych dyskusji. Rzecznik powiedział, że udostępnianie informacje zwrotne kanałami wewnętrznymi jest standardową praktyką w firmie Amazon i że w wyniku tych opinii nie zidentyfikowano żadnych problemów związanych z bezpieczeństwem. Firma podkreśliła znaczenie otrzymanych informacji zwrotnych i chęć kontynuacji udoskonalaj Amazon Q podczas przejścia z wersji zapoznawczej do ogólnej dostępności.

Amazon Q, dostępny obecnie w bezpłatnej wersji zapoznawczej, został zaprezentowany jako wersja oprogramowania dla przedsiębiorstw chatbota, którego początkowe funkcje miały na celu odpowiadanie na pytania programistów dotyczące AWS, modyfikowanie kodów źródłowych i cytowanie źródeł. Amazon położył nacisk na bezpieczeństwo i prywatność Q, porównując je z narzędziami konsumenckimi, takimi jak ChatGPT.

Jednakże wewnętrzny dokument ujawnił, że Q może mieć „halucynacje” i powodować szkodliwe lub niewłaściwe reakcje, np nieaktualne informacje dotyczące bezpieczeństwa co mogłoby narazić konta klientów na ryzyko. Ryzyko to jest typowe dla dużych modeli językowych, z których wszystkie przynajmniej w niektórych przypadkach zwykle dostarczają błędnych lub niewłaściwych odpowiedzi.

Via | Slashdot