Dyskusja dotycząca własności intelektualnej dotyczy zarówno człowieka, jak i modeli generatywnych. A raczej dotyczą firm, które „tworzą” takie modele. Pod tym względem w świecie cyfrowego generowania obrazu wprowadzono znaczącą innowację: wprowadzenie określonych znaków wodnych dla obrazów utworzonych za pośrednictwem DALL-E3. To obiecuje, że granicę między treściami sztucznie generowanymi a treściami stworzonymi przez człowieka nie tylko bardziej zdefiniowane, ale także bardziej przejrzyste.

Jak rozpoznać obrazy tworzone przez modele generatywne? Na początek ze znakiem wodnym na DALLE-E 3

OpenAI wprowadziło niedawno funkcję, która może zmienić sposób, w jaki postrzegamy treści cyfrowe: a system znaku wodnego dla obrazów generowanych przez DALL-E 3. Niniejsza aktualizacja ma na celu stworzenie pomostu pomiędzy rosnącą produkcją treści cyfrowych a potrzebą większej przejrzystości i niezawodności.

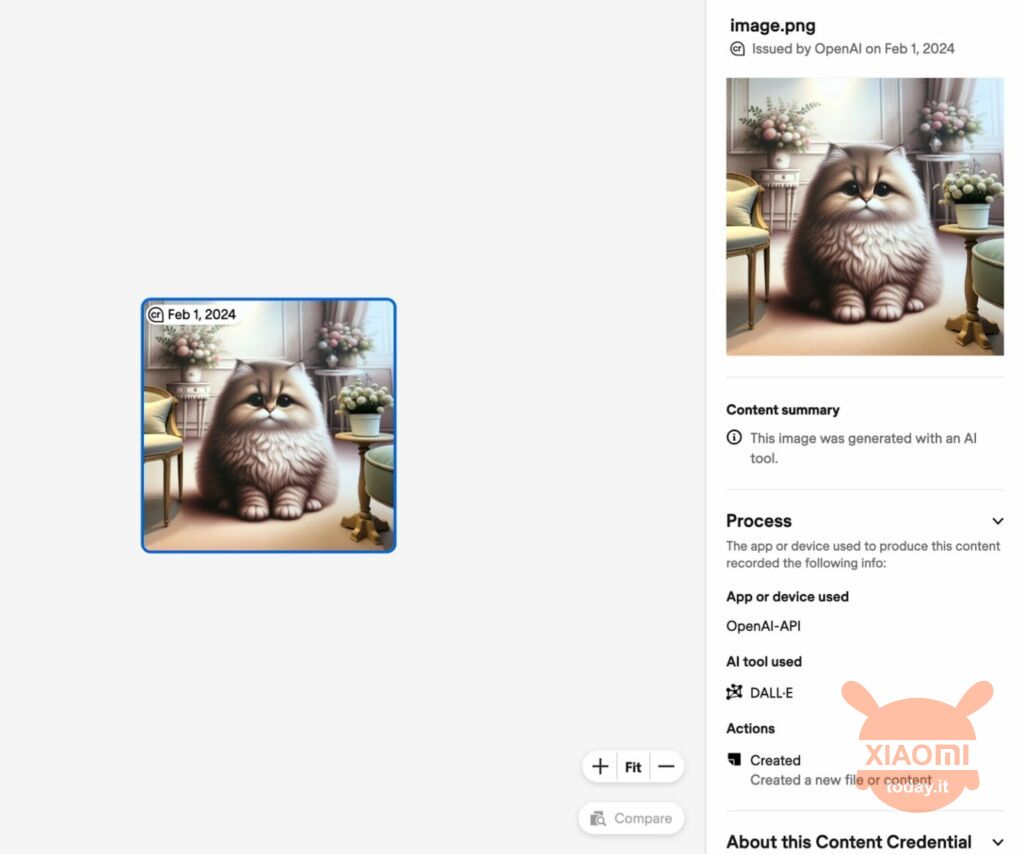

System znaku wodnego zaimplementowany w DALL-E 3 jest podzielony na z powodu składniki: niewidoczna część zintegrowana z metadanymi obrazu oraz widoczny symbol reprezentowany przez logo CR, dyskretnie umieszczony w lewym górnym rogu obrazu. Cel jest dwojaki: z jednej strony ułatwiają identyfikację pochodzenia obrazu cyfrowego, umożliwiając użytkownikom weryfikację, czy został wygenerowany przez sztuczną inteligencję; na inne, zachować jakość wizualną obrazu na niezmienionym poziomiepomimo dodania nowych elementów.

Zobacz także: DALL-E 3 jest oficjalny: teraz dla wszystkich na ChatGPT

Rozwój ten wpisuje się w szerszy kontekst, wspierany przez Koalicja na rzecz pochodzenia i autentyczności treści, konsorcjum składające się z gigantów technologicznych, takich jak Adobe i Microsoft. Są zobowiązani do promować autentyczność treści cyfrowych poprzez znak wodny Content Credentials, pomagając w ten sposób w wyraźnym rozróżnieniu pomiędzy pracą twórczą człowieka a pracą generowaną przez sztuczną inteligencję.

Pomimo entuzjazmu dla tej innowacji, nadal pozostają znaczące wyzwania, głównie związane z możliwość usunięcia metadanychdobrowolnie lub w inny sposób, podczas udostępniania w mediach społecznościowych lub innych platformach cyfrowych. Ta luka uwypukla złożoność zwalczania dezinformacji i potrzebę opracowania skutecznych strategii weryfikacji treści cyfrowych.